ИИ заставят расписаться

Страны G7 предлагают маркировать создаваемый искусственным интеллектом контент

Развитие технологий искусственного интеллекта (ИИ) вызывает у правительств желание контролировать эти процессы: в понедельник страны G7 приняли заявление об 11 принципах такого регулирования, включая внедрение системы маркировки созданного с применением ИИ контента. Одновременно в США опубликован президентский указ, обязующий разработчиков мощных систем ИИ делиться результатами тестирования безопасности и другой важной информацией с американскими властями. Эксперты отмечают, что заявление G7 фактически предписывает приоритет разработки международного регулирования ИИ под лидерством США.

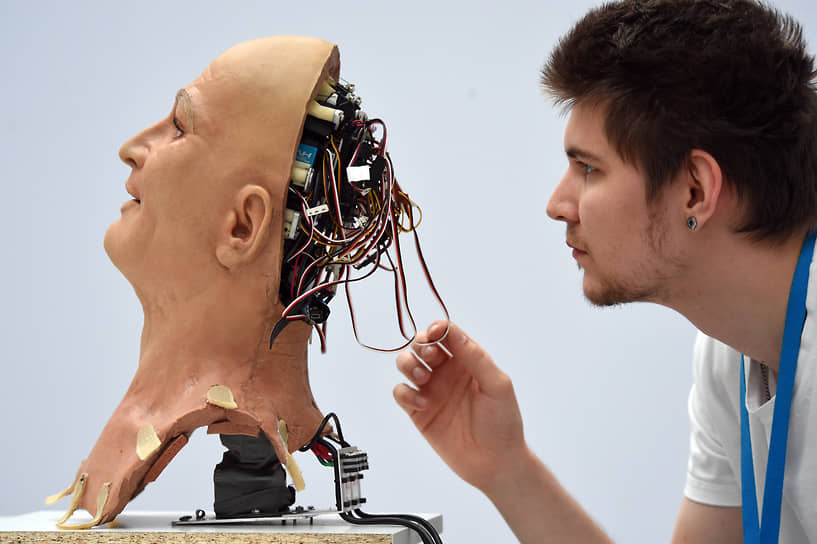

Фото: Анатолий Жданов, Коммерсантъ

Фото: Анатолий Жданов, Коммерсантъ

Лидеры стран «Большой семерки» (G7) в понедельник опубликовали совместное заявление о «руководящих принципах регулирования» ИИ (.pdf). Документ содержит 11 положений, обозначающих основные проблемы и риски, которые несет развитие этой технологии.

В частности, предложено внедрить маркировку создаваемого с применением ИИ контента, для того чтобы пользователи могли его идентифицировать.

Разработчики, по мнению G7, должны сообщать о возможностях и ограничениях систем ИИ, а также о сферах его «надлежащего и ненадлежащего применения». Компании должны обмениваться данными об инцидентах, в том числе с правительством, гражданским обществом и научными кругами.

Вчера же был опубликован указ президента США Джо Байдена о безопасном ИИ, с помощью которого Белый дом пытается взять риски этой технологии под контроль уже более определенными административными методами. Документ обязует разработчиков мощных систем ИИ делиться результатами тестирования по безопасности и другой важной информацией с американскими властями. Он касается компаний, разрабатывающих ИИ-модели, которые потенциально могут представлять риск для национальной и экономической безопасности США, для здоровья и безопасности населения.

Управляющий директор—начальник центра регулирования ИИ Сбербанка Андрей Незнамов отмечает, что документ G7 близок принципам ИИ, уже принятым ОЭСР, и во многом повторяет положения деклараций по этике ИИ от ЮНЕСКО.

Однако есть и относительно новые положения, такие как рекомендации о маркировке контента. Это является ответом на развитие генеративных систем. По его словам, в заявлении явно обозначен приоритет разработки международного регулирования и стандартов под лидерством США. Документы США и G7 содержат очень близкие формулировки на этот счет — например, подчеркивается важность использования ИИ для решений задач устойчивого развития ООН. Господин Незнамов отметил, что оба документа вышли перед саммитом по регулированию ИИ, который пройдет в Великобритании 1 ноября, и это выглядит как создание основы для обсуждения проблем ИИ на этой встрече.

Директор по правовым инициативам Фонда развития интернет-инициатив Александра Орехович отмечает, что на протяжении долгого времени в большинстве стран преобладала позиция мягкого регулирования ИИ. Однако в последнее время эти технологии стали развиваться темпами, при которых степень их влияния выявила угрозы: вмешательство в личную жизнь, дискриминация, дипфейки, отмечает она. В результате ряд стран стал задумываться об ограничениях для ИИ. При этом каждая пошла по своему пути: Китай — в сторону цензурирования контента, ЕС — защиты личности от дискриминации и технологий социального скоринга. «В целом, как и любое регулирование, регулирование ИИ, скорее всего, затормозит развитие технологий в определенных, наиболее высокорисковых сферах. Но очевидно, что страны, вводящие его, просчитывают этот риск»,— отмечает Александра Орехович. Гендиректор Агентства трансформации и развития экономики Владислав Онищенко полагает, что принятие регулирующих документов и стандартов развития технологий будет способствовать снижению рисков и росту аппетита прежде всего долгосрочных институциональных инвесторов: сейчас неограниченное развитие технологии ИИ снижает потенциальный интерес инвесторов.