Распространение технологии искусственного интеллекта (AI) может привести к росту киберпреступности и появлению ее новых форм, манипулированию общественным мнением и повреждению физической инфраструктуры уже в течение ближайших пяти лет, считают авторы доклада «Преступное использование AI: прогноз, профилактика и предотвращение».

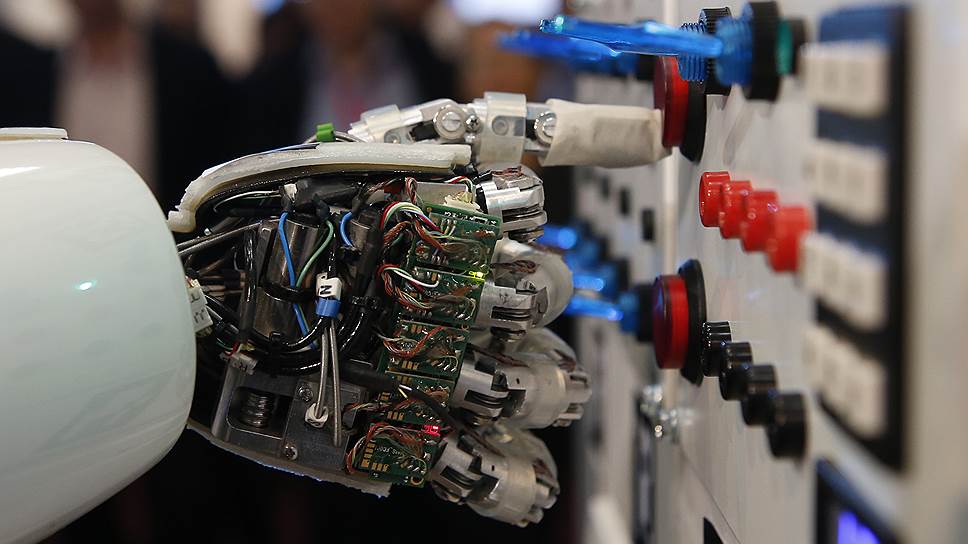

Фото: Евгений Павленко, Коммерсантъ / купить фото

100-страничный доклад написан 26 экспертами в сфере кибербезопасности. Среди них ученые из Оксфордского, Кембриджского и Стэнфордского университетов, аналитики некоммерческих организаций Electronic Frontier Foundation и OpenAI и представители других авторитетных организаций.

Авторы доклада сравнивают искусственный интеллект с ядерной энергией и взрывчатыми веществами, которые можно использовать как в мирных, так и в военных целях. «Когда возможности искусственного интеллекта станут более мощными и повсеместными, мы ожидаем, что это приведет к расширению существующих угроз, возникновению новых угроз и изменению типа угроз»,— предупреждают авторы.

«Многие из нас поражены масштабами того, что произошло за последние пять лет. Если это продолжится, вы увидите появление действительно опасных вещей»,— отмечает глава OpenAL Джек Кларк.

Разработчики должны на ранних этапах предусматривать возможность преступного использования искусственного интеллекта и создавать соответствующие ограничения, советуют авторы. Если это не будет сделано, искусственный интеллект станет мощным оружием в руках людей с преступными намерениями.

Авторы выделяют три главных направления угроз. Первая — искусственный интеллект поможет устраивать хакерские атаки. Технологии облегчат обнаружение уязвимостей ПО или выбор потенциальных жертв преступлений.

Также искусственный интеллект позволит использовать уязвимости человека. Например использовать синтез речи или создавать «контекстное» вредоносное ПО. Благодаря ему вероятность того, что пользователь нажмет на ссылку, запускающую вирус, или скачает нужное злоумышленникам приложение, резко вырастет. Хакерские атаки с применением подобных технологий будут намного масштабнее и эффективнее, чем сейчас.

Недобросовестное применение искусственного интеллекта в политической сфере также весьма вероятно. С его помощью власти создадут более мощные системы наблюдения за инакомыслящими.

Политические силы смогут проводить «автоматизированные, гиперперсонализированные кампании дезинформации». Искусственный интеллект сможет генерировать фейковые новости в таких количествах, что пользователю будет почти невозможно вычленить среди них настоящие.

Повысится эффективность и адресность пропаганды, манипулировать общественным мнением станет проще, предупреждают авторы. Особенно опасным это становится с учетом того, что с помощью искусственного интеллекта может быть сделан шаг вперед в изучении основ психологии поведения человека.

Третья группа угроз — возможность атак на физические объекты. Речь идет, например, о массовом управлении беспилотниками и другими автоматизированными боевыми комплексами.

Кроме того, искусственный интеллект будет способствовать злонамеренному внедрению в системы беспилотных автомобилей, с дальнейшими авариями или нападениями с их участием.

«Искусственный интеллект, цифровая безопасность, физическая безопасность и политическая безопасность прочно связаны, и их связь будет только укрепляться… Хотя конкретные риски бесчисленны, мы считаем, что понимание общих закономерностей поможет пролить свет на будущее и улучшить информирование для предотвращения и смягчения последствий»,— говорится в докладе.

Впрочем, некоторые эксперты отмечают, что масштаб проблемы может быть преувеличен. «Улучшения идут с обеих сторон — это постоянная гонка вооружений. Искусственный интеллект уже сейчас крайне полезен для кибербезопасности. Пока неясно, какая сторона извлечет больше выгоды», — считает сооснователь компании в сфере кибербезопасности CrowdStrike Дмитрий Альперович.

Десять технологий, которые потрясут мир

Главные тренды по версии Массачусетского технологического института